AI(人工知能)の世界最高峰の国際会議「AAAI-24」に採択

~フーリエ変換を使った新しい画像認識手法を開発~

2024年2月6日

立教大学

報道関係各位

立教大学大学院人工知能科学研究科(所在地:東京都豊島区、研究科委員長:内山 泰伸)の博士後期課程2年次の立浪 祐貴 さん(AnyTech株式会社勤務)と瀧 雅人 准教授がフーリエ変換を使った新しい画像認識手法を開発しました。この研究成果が、人工知能分野の国際会議の一つである「AAAI-24」(The 38th Annual AAAI Conference on Artificial Intelligence)に採択されたことをお知らせいたします。

「AAAI Conference on Artificial Intelligence」はアメリカ人工知能学会が主催する人工知能分野の世界トップレベルの国際会議です。今年は査読された9,862件の論文の中から、2,342件(全体の23.75%)の論文が採択されています。本研究成果は、2024年2月20日から2月27日までカナダのバンクーバーで開催される「AAAI-24」にて発表されます。

研究背景

深層学習において、注意機構は長距離の依存関係を学習するのに適している技術です。注意機構は、モデルが広範な範囲から重要な情報に焦点を当て、その情報に適切に注目することを可能にします。コンピュータビジョンにおいては、モデルが画像内の関連性が高い領域に注目することで、モデルが物体やパターンをより正確に認識できるようになると考えられています。ところが注意機構は大量のメモリを必要とする問題を孕んでいます。注意機構では、入力するすべての要素に対して個別の重み付けを計算し、その結果をメモリ内に保持します。この仕組みが、特に高解像度画像を扱うコンピュータビジョンモデルにおいては深刻な問題を引き起こします。画像の解像度が増えると、入力する要素の数が大きくなるため、膨大なメモリが必要となり、計算時間も急激に増えてしまいます。したがって、モデルが高解像度の画像を扱う場合、物理的リソースの制約から高価なハードウエアが必要となり、経済的負担を生む可能性があります。

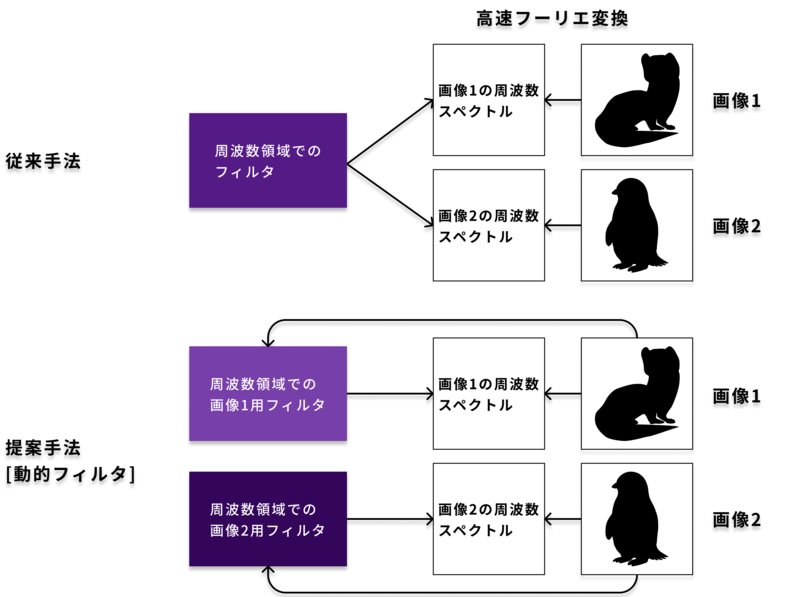

近年、この問題を回避できる手法として、注意機構に代わる高速フーリエ変換ベースの仕組みであるグローバルフィルタが提案されています。グローバルフィルタは注意機構と同様に長距離の空間依存性を学習することができます。この手法は、高速フーリエ変換、周波数領域における要素ごとの掛け算、逆高速フーリエ変換で構成されています。シンプルなこの手法は、注意機構とは異なり、解像度が増えても、大量のメモリを必要とすることもなく、計算量も穏やかに増加するのみです。しかしながら、グローバルフィルタは最先端の性能を達成しているとは言い難い現状がありました。

研究成果

本研究では、グローバルフィルタと注意機構の隔たりに注目し、その隔たりを埋めた動的フィルタを提案しました。グローバルフィルタはデータとパラメータを掛け合わせるため、データに依存しない演算です。対照的に、注意機構は個別の重み付けを計算するため、データに依存する演算です。このように、グローバルフィルタと注意機構にはデータに依存するか否かの差分があります。

そこで、データに掛け合わせるフィルタを動的に生成する仕組み「動的フィルタ」を導入しました。動的フィルタは、データに応じて重みを計算し、その重みと少数の基底フィルタから、データに応じたフィルタを生成します。このような方法を採用することで、グローバルフィルタの利点を享受したまま、注意機構のようなデータ依存性を実現できます。

次に、提案手法の動的フィルタを取り入れたDFFormerと、動的フィルタと畳み込みニューラルネットを併用したCDFFormerという新たな画像認識モデルを提案しました。グローバルフィルタと注意機構の間には、そのものの差だけでなく、それらを採用しているよりマクロなアーキテクチャの間にも差がありました。この差を埋めるために、最先端の精度を達成したアーキテクチャの上に動的フィルタを搭載し、フェアな比較の下で動的フィルタの有用性を確認しました。これらのモデルは注意機構を利用しない先端的な画像認識モデルに対して、競争的な精度を達成しています。そして、注意機構を使用する最先端のモデルに対しては、従来よりも精度が近づいており、先述の注意機構に関する問題を克服しています。つまり、高解像度の画像認識において、グローバルフィルタと同様に、提案手法は相対的に少ないメモリ消費や計算時間で済むという特長を有しています。

今後の展望

本研究では、DFFormerとCDFFormerを開発しました。これらのモデルの成功により、高速フーリエ変換ベースの手法が再評価される可能性があります。近年注意機構を使用した巨大なモデルばかり注目される傾向はありますが、動的フィルタのように訓練や推論時の経済的負担が少ないアプローチも重要視される契機となるでしょう。それだけでなく、動的フィルタを通して、注意機構に関する理解を深める研究が促進されることも期待されます。

キーワード

・AAAI(AAAI Conference on Artificial Intelligence):人工知能に関するトップレベルの国際会議。

・コンピュータビジョン:コンピュータに画像の認識や処理を行わせる分野。

・注意機構:深層学習モデルが重要な情報を自身で判断して、そこに注意を集中させてデータを理解する仕組み。生物が重要な情報だけに注意を向けて、対象を認識する様子の模倣。

・畳み込み:局所的な情報を集約することで、画像などから情報抽出をする手法。一種のフィルタリング。

・畳み込みニューラルネット:畳み込みを使った画像に特化したニューラルネット。

・フーリエ変換:音声や画像のような信号を異なる周波数の成分に分解する数学的手法。

・高速フーリエ変換:フーリエ変換を効率的に計算するアルゴリズム。

論文情報

・論文タイトル:FFT-based Dynamic Token Mixer for Vision

・著者:Yuki Tatsunami, Masato Taki

・論文リンク:https://arxiv.org/abs/2303.03932

人工知能科学研究科 瀧雅人研究室について

瀧雅人研究室では、これからのAIの応用を支える深層学習の基礎から応用までを幅広く研究しています。本成果以外にも、2022年には機械学習分野の国際会議「NeurIPS 2022」に論文が採択されるなどの成果を残しています。

.jpg)

-1.jpg)

_クレジット追加.jpg)

.jpg)